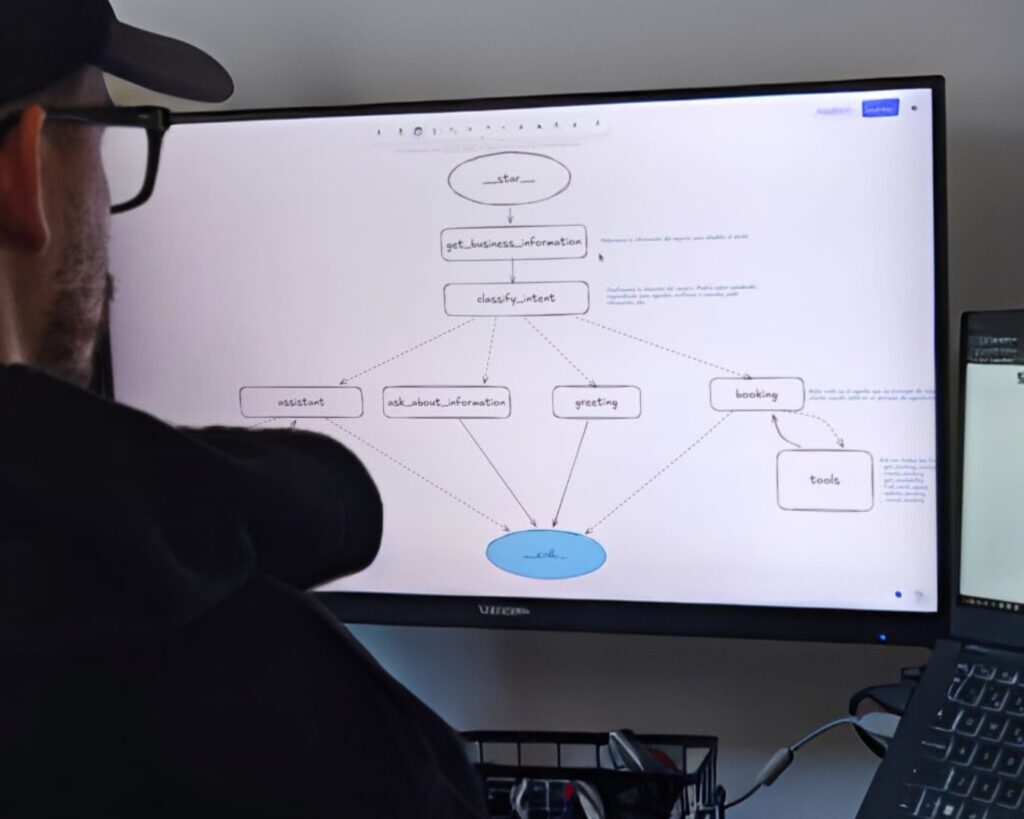

Antes de comenzar con la configuración técnica del entorno, es importante comprender los fundamentos detrás de los agentes de inteligencia artificial y cómo frameworks como LangChain y LangGraph permiten construir flujos de trabajo inteligentes, modulares y escalables. Estos conceptos son clave para aprovechar al máximo las capacidades de los modelos de lenguaje y evitar implementaciones improvisadas o difíciles de mantener.

Si todavía no leíste la base conceptual, te recomendamos revisar la guía “Construyendo agentes de IA con LangChain y LangGraph: conceptos”, donde se explican de forma clara los principios, la arquitectura y los casos de uso más comunes de estos frameworks. Este conocimiento previo te va a ayudar a entender mejor cada paso de esta guía y a tomar mejores decisiones técnicas al momento de desarrollar tus propios agentes de IA.

Requisitos Previos

- Ubuntu 24.04 instalado

- Editor de código (VS Code, PyCharm, etc.)

- Conexión a internet

Paso 1: Instalar Python 3.11+

LangGraph requiere Python 3.11 o superior. Verificá tu versión actual:

python3 --versionSi necesitás instalar o actualizar Python:

sudo apt update

sudo apt install python3.11 python3.11-venv python3-pip -yPaso 2: Crear el Directorio del Proyecto

mkdir mi-proyecto-langgraph

cd mi-proyecto-langgraphPaso 3: Crear y Activar un Entorno Virtual

Es una buena práctica usar entornos virtuales para aislar las dependencias del proyecto:

python3 -m venv venv

source venv/bin/activateDeberías ver (venv) al inicio de tu línea de comandos.

Paso 4: Instalar LangGraph y Dependencias

Instalá LangGraph y LangChain:

pip install --upgrade pip

pip install langgraph langchain langchain-core langraph-cli langgraph-apiPaso 5: Crear una Cuenta en LangSmith

LangSmith es una plataforma para monitorear, depurar y evaluar aplicaciones LLM.

- Andá a https://smith.langchain.com/

- Hacé clic en «Sign Up» o «Get Started»

- Completá el registro con tu correo electrónico y contraseña

- Verificá tu correo electrónico si es necesario

- Iniciá sesión en tu cuenta de LangSmith

Paso 6: Generar una API Key de LangSmith

- Una vez dentro de LangSmith, andá a Settings (Configuración) en el menú lateral

- Buscá la sección «API Keys»

- Hacé clic en «Create API Key» o «+ New API Key»

- Dale un nombre descriptivo a tu clave (ejemplo: «Proyecto LangGraph Local»)

- Copiá la API key generada (guardala en un lugar seguro, no podrás verla de nuevo)

Paso 7: Configurar Variables de Entorno

Creá un archivo .env en la raíz de tu proyecto para almacenar las credenciales:

touch .envAbrí el archivo .env con tu editor y agregá:

LANGCHAIN_TRACING_V2=true

LANGCHAIN_ENDPOINT=https://api.smith.langchain.com

LANGCHAIN_API_KEY=tu_api_key_de_langsmith_aqui

LANGCHAIN_PROJECT=mi-proyecto-langgraphReemplazá tu_api_key_de_langsmith_aqui con la API key que copiaste.

Paso 8: Obtener API Key de un Proveedor LLM

LangGraph soporta múltiples proveedores de modelos de lenguaje. Seleccioná uno de los siguientes:

- OpenAI – Registrate en platform.openai.com y generá una API key

- Anthropic (Claude) – Registrate en console.anthropic.com

- Google (Gemini) – Obtené credenciales en ai.google.dev

- Cohere – Registrate en dashboard.cohere.com

- Azure OpenAI – Configurá en tu portal de Azure

Agregá la API key de tu proveedor elegido al archivo .env:

# Para OpenAI

OPENAI_API_KEY=tu_api_key_de_openai

# Para Anthropic

ANTHROPIC_API_KEY=tu_api_key_de_anthropic

# Para Google

GOOGLE_API_KEY=tu_api_key_de_googlePaso 9: Instalar el Paquete del Proveedor LLM

# Para OpenAI

pip install langchain-openai

# Para Anthropic

pip install langchain-anthropic

# Para Google

pip install langchain-google-genai

# Para Cohere

pip install langchain-coherePaso 10: Instalar python-dotenv

Para cargar las variables de entorno desde el archivo .env:

pip install python-dotenvPaso 11: Crear un Archivo de Prueba

Creá un archivo test_setup.py para verificar la instalación:

from dotenv import load_dotenv

import os

# Cargar variables de entorno

load_dotenv()

# Verificar que las variables están cargadas

print("LANGCHAIN_API_KEY:", "✓ Configurada" if os.getenv("LANGCHAIN_API_KEY") else "✗ No encontrada")

print("OPENAI_API_KEY:", "✓ Configurada" if os.getenv("OPENAI_API_KEY") else "✗ No encontrada")

# Prueba simple de LangGraph

from langgraph.graph import StateGraph

from typing import TypedDict

class State(TypedDict):

mensaje: str

def nodo_saludo(state: State):

return {"mensaje": "¡Hola desde LangGraph!"}

# Crear grafo

workflow = StateGraph(State)

workflow.add_node("saludo", nodo_saludo)

workflow.set_entry_point("saludo")

workflow.set_finish_point("saludo")

app = workflow.compile()

# Ejecutar

resultado = app.invoke({"mensaje": ""})

print("\nResultado:", resultado)Paso 12: Ejecutar la Prueba

python test_setup.pySi todo está configurado correctamente, deberías ver las confirmaciones de las API keys y el mensaje de saludo.

Paso 13: Crear requirements.txt

pip freeze > requirements.txtPaso 14: Configurar .gitignore

Si usás Git, creá un archivo .gitignore para evitar subir información sensible:

.env

venv/

__pycache__/

*.pyc

.DS_Store¡Entorno Listo!

Tu entorno de desarrollo para LangGraph está completamente configurado. Ahora podés empezar a construir tus agentes de IA.

Comandos Útiles

- Activar entorno virtual:

source venv/bin/activate - Desactivar entorno virtual:

deactivate - Instalar desde requirements.txt:

pip install -r requirements.txt - Actualizar dependencias:

pip install --upgrade langgraph langchain